File robots.txt là tệp tin nhỏ nhưng đóng vai trò lớn trong việc điều hướng hoạt động thu thập dữ liệu của công cụ tìm kiếm. Cấu hình đúng robots.txt giúp website tối ưu SEO, bảo vệ dữ liệu quan trọng và cải thiện khả năng hiển thị trên Google. Bài viết này của VinUni sẽ hướng dẫn bạn hiểu rõ khái niệm, cách tạo và tối ưu file robots.txt chuẩn SEO cho WordPress.

1. File robots.txt là gì ?

File robots.txt là một tệp văn bản đơn giản được đặt trong thư mục gốc của website – ví dụ: https://yourwebsite.com/robots.txt. Mục đích của tệp này là giao tiếp với các trình thu thập dữ liệu (web crawlers hoặc bots) của công cụ tìm kiếm như Google, Bing hay Yahoo, thông qua các quy tắc được thiết lập sẵn.

Cụ thể, robots.txt cho phép quản trị viên chỉ định phần nào của website được phép truy cập và phần nào cần hạn chế. Đây là thành phần cốt lõi trong robots exclusion protocol, một tiêu chuẩn quốc tế được sử dụng để kiểm soát hoạt động của bot trên toàn bộ Internet.

File robots.txt là tệp tin nhỏ nhưng đóng vai trò lớn trong việc điều hướng hoạt động thu thập dữ liệu của công cụ tìm kiếm

Thông qua các chỉ thị meta (meta directives) như Allow (được phép) hoặc Disallow (bị hạn chế), người quản trị có thể kiểm soát cách các công cụ tìm kiếm thu thập dữ liệu và lập chỉ mục các thư mục, trang con hoặc tài nguyên cụ thể.

Nếu như file robots.txt quy định quyền truy cập ở mức toàn trang web, thì thẻ meta robots (meta robots tag) lại được áp dụng ở mức từng trang riêng lẻ nhằm kiểm soát chi tiết hơn quá trình lập chỉ mục nội dung.

2. Cú pháp của file robots.txt

Cấu trúc của file robots.txt chuẩn khá đơn giản, bao gồm các chỉ thị (directives) mô tả cách mà các công cụ tìm kiếm được phép hoặc bị hạn chế truy cập vào các phần khác nhau của website. Mỗi chỉ thị trong file sẽ tuân theo cú pháp cơ bản như trong bảng dưới đây:

| Thành phần | Cú pháp | Ý nghĩa | Ví dụ minh họa |

| User-agent | User-agent: [tên bot] | Xác định bot hoặc công cụ tìm kiếm mà quy tắc áp dụng. Dấu * có nghĩa là áp dụng cho tất cả bot. | User-agent: GooglebotUser-agent: * |

| Disallow | Disallow: [đường dẫn] | Chặn bot truy cập vào một thư mục hoặc trang cụ thể trên website. | Disallow: /admin/Disallow: /temp/page.html |

| Allow | Allow: [đường dẫn] | Cho phép bot truy cập vào một tệp hoặc thư mục cụ thể, ngay cả khi nằm trong vùng bị chặn. | Allow: /admin/public-info.html |

| Sitemap | Sitemap: [URL] | Khai báo vị trí của file sitemap.xml, giúp công cụ tìm kiếm thu thập dữ liệu website hiệu quả hơn. | Sitemap: https://yourwebsite.com/sitemap.xml |

| # (Comment) | # [nội dung chú thích] | Dòng chú thích, không ảnh hưởng đến quy tắc. Dùng để ghi chú hoặc mô tả cho người quản trị. | # Không cho phép bot truy cập trang quản trị |

Bảng giải thích cú pháp trong file robots.txt

Ví dụ file robots.txt hoàn chỉnh:

User-agent: *

Disallow: /private/

Allow: /private/public-access.html

Sitemap: https://yourwebsite.com/sitemap.xml

#Quy tắc chung áp dụng cho tất cả bot

3. Tại sao cần có file robots.txt cho website?

Một file robots.txt được cấu hình đúng cách không chỉ là yếu tố kỹ thuật cơ bản của website mà còn là công cụ chiến lược trong quản lý SEO. Nó giúp điều hướng hoạt động thu thập dữ liệu của các công cụ tìm kiếm một cách thông minh, tối ưu hiệu suất trang và bảo vệ tài nguyên máy chủ.

- Quản lý ưu tiên thu thập dữ liệu: Robots.txt cho phép bạn hướng bot tập trung vào những trang có giá trị SEO cao, đồng thời bỏ qua các trang trùng lặp, trang thử nghiệm hoặc khu vực không cần lập chỉ mục. Điều này giúp tăng hiệu quả sử dụng ngân sách thu thập dữ liệu và đảm bảo các nội dung quan trọng được ưu tiên hiển thị trên Google.

- Tối ưu hóa việc sử dụng sơ đồ website (sitemap): Bằng cách khai báo đường dẫn sitemap trong robots.txt, bạn giúp bot truy cập nhanh đến cấu trúc nội dung của toàn website. Nhờ đó, quá trình lập chỉ mục diễn ra hiệu quả, đầy đủ và chính xác hơn, đặc biệt với những website có hàng trăm hoặc hàng nghìn trang con.

- Tiết kiệm tài nguyên máy chủ: Mỗi lần bot thu thập dữ liệu là một yêu cầu HTTP gửi đến máy chủ. Robots.txt giúp giảm thiểu hoạt động không cần thiết, tránh tình trạng quá tải và đảm bảo website vận hành ổn định – nhất là với các website có lưu lượng truy cập lớn hoặc tài nguyên giới hạn.

- Bảo vệ tài liệu và dữ liệu nhạy cảm: Tệp này giúp bạn ngăn các công cụ tìm kiếm truy cập vào khu vực quản trị, tài liệu nội bộ hoặc tệp chứa thông tin bảo mật (ví dụ: /admin/, /config/, /private/). Mặc dù không phải công cụ bảo mật tuyệt đối, robots.txt vẫn là lớp phòng ngừa đầu tiên trong quản lý truy cập tự động.

- Hỗ trợ chiến lược SEO tổng thể: Một cấu hình robots.txt hợp lý giúp tăng hiệu quả SEO tổng thể, đảm bảo Googlebot tập trung thu thập dữ liệu đúng nơi, đúng nội dung. Điều này cải thiện khả năng hiển thị và thứ hạng của website trên trang kết quả tìm kiếm.

4. Những hạn chế của file robots.txt

Mặc dù file robots.txt là công cụ hữu ích giúp quản lý hoạt động thu thập dữ liệu (crawling) của công cụ tìm kiếm, nhưng nó không phải là phương pháp tuyệt đối để ngăn nội dung xuất hiện trên Internet. Trước khi tạo hoặc chỉnh sửa tệp này, bạn nên hiểu rõ các giới hạn của nó để tránh hiểu nhầm về chức năng thực tế.

- Không phải mọi công cụ tìm kiếm đều tuân thủ quy tắc robots.txt

Các quy tắc trong file robots.txt chỉ mang tính hướng dẫn (directive) chứ không bắt buộc. Googlebot, Bingbot hay các trình thu thập dữ liệu uy tín khác sẽ tuân thủ nghiêm túc những quy định này, nhưng nhiều bot tìm kiếm (crawler) không chính thống hoặc bot spam có thể phớt lờ hoàn toàn.

Vì vậy, nếu bạn muốn bảo mật thông tin quan trọng hoặc tránh bị truy cập trái phép, hãy sử dụng các phương thức bảo vệ khác như mật khẩu, tường lửa hoặc chặn IP, thay vì chỉ dựa vào robots.txt.

- Cách diễn giải cú pháp có thể khác nhau giữa các crawler

Mặc dù hầu hết công cụ tìm kiếm đều tuân theo tiêu chuẩn robots exclusion protocol, nhưng mỗi crawler có thể hiểu cú pháp khác nhau.

Ví dụ, một số bot có thể không nhận diện được các chỉ thị nâng cao như Allow, Crawl-delay, hoặc ký tự đại diện *.

Điều này đồng nghĩa rằng cùng một tệp robots.txt, có thể được hiểu khác nhau trên các nền tảng tìm kiếm khác nhau, dẫn đến việc crawl không đồng nhất.

- URL bị chặn vẫn có thể xuất hiện trên kết quả tìm kiếm

Một hiểu lầm phổ biến là: “Disallow trong robots.txt sẽ ngăn hoàn toàn URL xuất hiện trên Google.”

Thực tế, Google có thể vẫn lập chỉ mục (index) URL bị chặn, nếu URL đó được liên kết từ các website khác. Khi đó, trang có thể hiển thị trong kết quả tìm kiếm chỉ với tiêu đề hoặc đường dẫn, nhưng nội dung bên trong sẽ không được thu thập.

Để ngăn hoàn toàn việc hiển thị URL, bạn nên: Sử dụng thẻ meta noindex hoặc HTTP header noindex; đặt mật khẩu bảo vệ thư mục hoặc tệp nhạy cảm; hoặc xóa hoàn toàn trang khỏi máy chủ.

5. File robots.txt hoạt động ra sao?

File robots.txt hoạt động như một tập hợp chỉ dẫn (set of instructions) dành cho các trình thu thập dữ liệu (web crawlers hoặc bots) khi truy cập vào một website. Khi một bot gửi yêu cầu HTTP đến máy chủ của trang web, bước đầu tiên mà nó thực hiện không phải là thu thập nội dung, mà là kiểm tra file robots.txt được đặt tại thư mục gốc.

Dựa trên các quy tắc được thiết lập trong tệp này, bot sẽ xác định những khu vực nào của website được phép truy cập (Allow) và những khu vực nào bị hạn chế (Disallow).

File robots.txt hoạt động dựa trên các quy tắc được thiết lập

Cơ chế này giúp kiểm soát phạm vi thu thập dữ liệu (crawl scope), đồng thời đảm bảo rằng hoạt động lập chỉ mục (indexing) của công cụ tìm kiếm tập trung vào những nội dung có giá trị, tránh gây quá tải tài nguyên cho máy chủ.

Nhờ đó, robots.txt đóng vai trò như một tầng trung gian định hướng hành vi của bot, giúp quá trình thu thập dữ liệu diễn ra có tổ chức, nhất quán và thân thiện với SEO hơn.

6. Cách kiểm tra Website có file robots.txt không?

Để xác định website có tệp robots.txt hay không, cách đơn giản nhất là truy cập trực tiếp vào đường dẫn https://tenmiencuaban.com/robots.txt (ví dụ: https://vinuni.edu.vn/robots.txt) . Nếu trình duyệt hiển thị nội dung văn bản với các chỉ thị như User-agent, Disallow hoặc Sitemap, nghĩa là tệp tồn tại và hoạt động bình thường. Ngược lại, nếu xuất hiện thông báo lỗi “404 Not Found”, website có thể chưa thiết lập hoặc đặt sai vị trí file robots.txt trong thư mục gốc.

Có rất nhiều cách để kiếm tra Website có file robots.txt không

Ngoài cách kiểm tra thủ công, Google Search Console cũng cung cấp một công cụ chuyên biệt giúp xác minh và phân tích file robots.txt. Bằng cách đăng nhập vào Google Search Console và truy cập phần robots.txt Tester, người quản trị có thể xem nội dung hiện tại của tệp, kiểm tra tình trạng hoạt động, cũng như chạy thử để xác định một URL cụ thể có bị chặn bởi robots.txt hay không.

Bên cạnh đó, các công cụ SEO phân tích kỹ thuật của bên thứ ba như Ahrefs Site Audit, Screaming Frog SEO Spider, hoặc Semrush Site Audit Tool cũng có thể được sử dụng để đánh giá sâu hơn. Những công cụ này có khả năng tự động quét toàn bộ website, phát hiện vị trí và nội dung của file robots.txt, xác định các lỗi truy cập hoặc xung đột quy tắc, đồng thời đánh giá mức độ tương thích của tệp với các bot phổ biến như Googlebot, Bingbot hoặc Yandexbot. Phương pháp này đặc biệt hữu ích với các doanh nghiệp hoặc tổ chức quản lý hệ thống website quy mô lớn, nơi cần giám sát đồng thời nhiều tên miền hoặc phiên bản ngôn ngữ khác nhau.

7. Vị trí của File robots.txt trên website

File robots.txt phải được đặt tại thư mục gốc của tên miền để các công cụ tìm kiếm có thể nhận diện và truy cập. Điều này có nghĩa là tệp cần nằm trực tiếp dưới cấu trúc địa chỉ chính, ví dụ: https://www.tenmiencuaban.com/robots.txt

File robots.txt nằm tại thư mục gốc của tên miền

Nếu website có nhiều thư mục con hoặc sử dụng các tên miền phụ (subdomain), mỗi tên miền hoặc subdomain đều có thể có một file robots.txt riêng biệt. Ví dụ, blog.tenmiencuaban.com/robots.txt sẽ được xử lý độc lập với file của tên miền chính.

Việc đặt sai vị trí tệp, chẳng hạn như trong các thư mục con (/home/robots.txt hoặc /public_html/robots.txt), sẽ khiến các bot tìm kiếm không thể đọc được và bỏ qua hoàn toàn các chỉ thị bên trong. Do đó, đảm bảo file Robots txt chuẩn được đặt đúng vị trí trong thư mục gốc (root directory) là yêu cầu bắt buộc để website được crawl và index đúng cách.

8. 3 cách tạo file robots.txt cho WordPress đơn giản

Trong hệ thống WordPress, việc tạo và quản lý file robots.txt chuẩn có thể thực hiện linh hoạt thông qua các plugin (tiện ích mở rộng) SEO chuyên dụng hoặc tạo thủ công qua giao thức FTP. Dưới đây là ba phương pháp phổ biến và hiệu quả nhất.

8.1. Tạo file robots.txt bằng plugin Yoast SEO

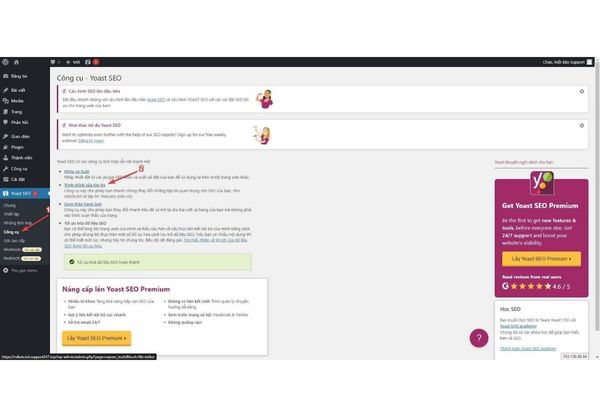

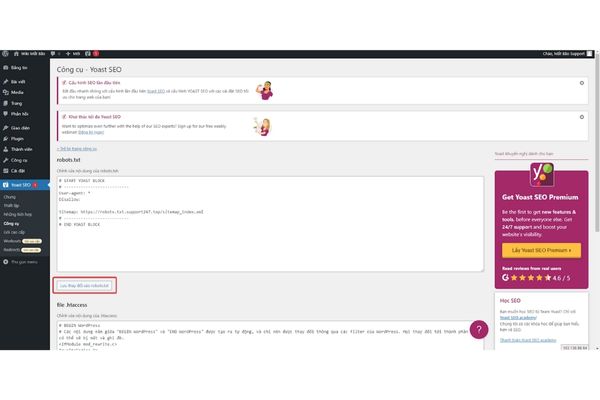

Sau khi cài đặt và kích hoạt plugin Yoast SEO, người dùng truy cập mục SEO → Công cụ → Trình chỉnh sửa tập tin.

Hướng dẫn tạo file robots.txt bằng plugin Yoast SEO

Tại đây, bạn có thể tạo mới hoặc chỉnh sửa trực tiếp nội dung file robots.txt. Sau đó, nhấn nút Tạo File robots.txt, và Lưu thay đổi vào robots.txt để hoàn tất quá trình tạo file.

Hoàn tất quá trình tạo file robots.txt với Yoast SEO

Phương pháp này có ưu điểm là dễ sử dụng, không cần thao tác với mã nguồn và phù hợp cho người quản trị không có kiến thức kỹ thuật sâu.

8.2. Tạo file robots.txt với Plugin All in One SEO

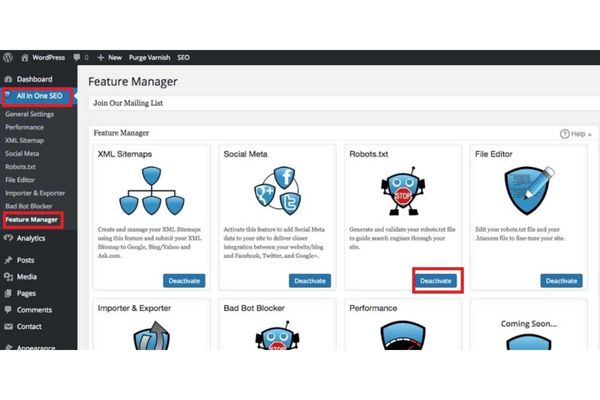

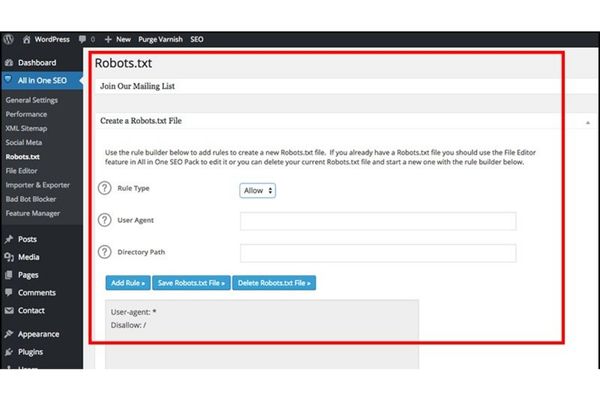

Tương tự như Yoast, All in One SEO cũng hỗ trợ chức năng Robots.txt Editor.

Hướng dẫn tạo file Robot.txt với All in One SEO

Người dùng vào All in One SEO → Chọn Feature Manager → Chọn Active cho mục Robots.txt.

Hoàn thiện file Robot.txt với All in One SEO

Sau đó thêm hoặc chỉnh sửa các chỉ thị cần thiết. Cách này giúp tối ưu nhanh mà vẫn đảm bảo tính an toàn cho hệ thống WordPress.

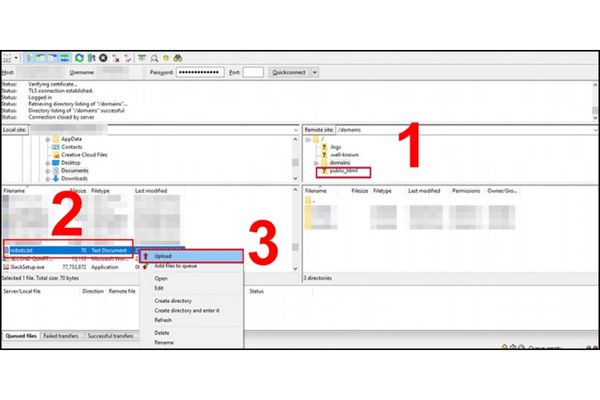

8.3. Tạo và upload file robots.txt qua FTP

Đây là phương pháp thủ công dành cho người dùng có kiến thức kỹ thuật cơ bản. File Robots.txt được tạo bằng trình soạn thảo văn bản (như Notepad) và lưu dưới định dạng .txt. Sau đó, sử dụng phần mềm FTP (chẳng hạn như FileZilla) để upload trực tiếp tệp lên thư mục gốc của website – thông thường là public_html hoặc www.

Hướng dẫn tạo và upload file robots.txt qua FTP

Ưu điểm của cách này là kiểm soát hoàn toàn nội dung file, không phụ thuộc vào plugin, nhưng đòi hỏi thao tác cẩn trọng để tránh ghi đè hoặc sai vị trí tệp.

Ba phương pháp trên đều cho phép quản trị viên tùy chỉnh quyền truy cập của bot tìm kiếm, giúp website WordPress được crawl và index hiệu quả, đồng thời duy trì cấu trúc SEO bền vững.

9. Các quy tắc quan trọng cần có trong file Robots.txt cho WordPress

File obots.txt chuẩn của WordPress cần được cấu hình cẩn thận để vừa đảm bảo khả năng thu thập dữ liệu hiệu quả, vừa bảo vệ các thư mục hệ thống khỏi việc truy cập không cần thiết. Dưới đây là các quy tắc cốt lõi nên có trong tệp này:

- Cho phép bot truy cập các nội dung công khai.

Phần lớn nội dung bài viết, trang và hình ảnh cần được công cụ tìm kiếm thu thập để lập chỉ mục. Vì vậy, nên mở quyền truy cập mặc định cho toàn bộ website:

User-agent: *

Allow: /

- Chặn bot truy cập thư mục quản trị và hệ thống WordPress.

Các thư mục này không chứa nội dung hiển thị cho người dùng và không cần lập chỉ mục, do đó cần được giới hạn:

Disallow: /wp-admin/

Disallow: /wp-includes/

- Cho phép truy cập tệp cần thiết trong khu vực quản trị.

Dù thư mục /wp-admin/ bị chặn, vẫn cần mở quyền cho tệp admin-ajax.php – thành phần quan trọng trong hoạt động của nhiều plugin và theme:

Allow: /wp-admin/admin-ajax.php

- Không chặn các tài nguyên tĩnh quan trọng (CSS, JS, hình ảnh).

Những thư mục này giúp Google hiểu và hiển thị đúng bố cục website. Việc chặn sẽ khiến Google đánh giá sai khả năng hiển thị của trang. Do đó, cần đảm bảo được phép truy cập:

Allow: /wp-content/uploads/

Allow: /wp-content/themes/

Allow: /wp-content/plugins/

- Khai báo đường dẫn sitemap để hỗ trợ lập chỉ mục.

Đây là thành phần quan trọng giúp bot định hướng nhanh đến toàn bộ cấu trúc website:

Sitemap: https://www.tenmiencuaban.com/sitemap.xml

- Không sử dụng lệnh Disallow quá rộng.

Việc chặn toàn bộ website bằng dòng Disallow: / sẽ khiến Google không thể thu thập bất kỳ nội dung nào, ảnh hưởng nghiêm trọng đến SEO. Chỉ nên dùng khi cần ngừng crawl tạm thời trong quá trình bảo trì.

- Tránh lặp hoặc xung đột quy tắc.

Không nên sử dụng nhiều dòng User-agent: * với các chỉ thị khác nhau. Hãy gom nhóm quy tắc liên quan trong cùng một phần để đảm bảo bot đọc đúng thứ tự ưu tiên.

10. Những lưu ý khi sử dụng file robots.txt

Trong quá trình sử dụng và quản lý file robots.txt, quản trị viên cần hiểu rằng đây không phải là công cụ bảo mật, mà là tệp hướng dẫn hành vi thu thập dữ liệu của bot. Vì vậy, việc cấu hình sai có thể dẫn đến lỗi nghiêm trọng trong quá trình index hoặc hiển thị nội dung. Dưới đây là những lưu ý quan trọng cần ghi nhớ:

- Không sử dụng robots.txt để ẩn thông tin nhạy cảm.

- Không nhầm lẫn giữa Disallow và Noindex.

- Kiểm tra định kỳ để phát hiện lỗi cấu hình.

- Không chặn các tài nguyên cần thiết cho việc hiển thị trang.

- Luôn khai báo sitemap trong robots.txt.

- Giữ nội dung tệp đơn giản và dễ đọc.

Tóm lại, việc sử dụng robots.txt hiệu quả không chỉ đòi hỏi hiểu rõ chức năng và giới hạn của tệp, mà còn cần duy trì thói quen kiểm tra, tối ưu và cập nhật định kỳ. Một file robots.txt được quản lý đúng cách sẽ góp phần quan trọng vào sự ổn định, hiệu quả thu thập dữ liệu và xếp hạng SEO tổng thể của website.

11. Một số quy tắc cần biết khi tạo file robots.txt

Để file robots.txt chuẩn được các công cụ tìm kiếm nhận diện và hoạt động đúng cách, quản trị viên cần tuân thủ đầy đủ các quy tắc sau:

- Tên tệp phải là robots.txt: Tên tệp phải được viết chính xác, bao gồm toàn bộ ký tự thường. Bất kỳ thay đổi nào như viết hoa hoặc thêm phần mở rộng khác (ví dụ .text, .doc) đều khiến tệp không hợp lệ và bị công cụ tìm kiếm bỏ qua.

- Mỗi website chỉ có một file robots.txt: Một tên miền hoặc host chỉ nên chứa duy nhất một tệp robots.txt để đảm bảo tính nhất quán. Việc tồn tại nhiều tệp cùng lúc có thể khiến bot không thể xác định quy tắc chính xác để thực thi.

- File phải được đặt tại thư mục gốc của website: Địa chỉ hợp lệ là https://www.example.com/robots.txt. Việc đặt tệp trong thư mục con như /pages/robots.txt hoặc /home/robots.txt là không hợp lệ. Nếu không thể truy cập thư mục gốc, nên liên hệ nhà cung cấp hosting hoặc sử dụng thẻ meta robots thay thế.

- Có thể đặt file riêng cho từng subdomain hoặc cổng (port): Ví dụ, https://blog.example.com/robots.txt có thể hoạt động độc lập với https://www.example.com/robots.txt, hoặc tệp có thể tồn tại ở cổng phi tiêu chuẩn như https://example.com:8181/robots.txt.

- Phạm vi hiệu lực giới hạn theo giao thức, tên miền và cổng: Tệp https://example.com/robots.txt chỉ áp dụng cho chính tên miền và giao thức đó, không ảnh hưởng đến https://m.example.com/ hay http://example.com/.

- Tệp phải được mã hóa theo chuẩn UTF-8: File robots.txt cần được lưu dưới định dạng UTF-8 (bao gồm ASCII). Các ký tự nằm ngoài phạm vi mã hóa này có thể bị Google bỏ qua, làm cho một số quy tắc không có hiệu lực.

12. Câu hỏi thường gặp về file robots.txt

Kích thước tối đa của file robots.txt là bao nhiêu?

Google khuyến nghị kích thước tối đa là 500 KB. Nếu vượt quá, công cụ tìm kiếm có thể bỏ qua phần nội dung sau giới hạn này.

File robots.txt WordPress nằm ở đâu?

File này thường được đặt tại thư mục gốc của website, địa chỉ thông thường là: https://tenmiencuaban.com/robots.txt.

Nếu không thấy tệp trong thư mục, bạn có thể tạo mới bằng plugin hoặc qua FTP.

Chỉnh sửa robots.txt WordPress như thế nào?

Người dùng có thể chỉnh sửa trực tiếp qua plugin Yoast SEO hoặc All in One SEO, mục Tools → File Editor / Robots.txt. Ngoài ra, có thể tải file lên và thay thế qua FTP.

Nếu Disallow vào nội dung Noindex thì sao?

Trường hợp này, bot có thể không đọc được thẻ noindex vì bị chặn ngay từ đầu bởi Disallow. Do đó, nếu muốn ngăn lập chỉ mục, hãy sử dụng thẻ meta noindex thay vì chặn bằng robots.txt.

Cách tạm ngừng thu thập dữ liệu website?

Bạn có thể thêm lệnh sau vào file robots.txt:

User-agent: *

Disallow: /

Lưu ý rằng đây chỉ là biện pháp tạm thời. Để ngăn truy cập tuyệt đối, cần sử dụng mật khẩu hoặc hạn chế IP truy cập trên máy chủ.

13. Mở rộng mạng lưới sự nghiệp với chương trình MBA tại viện Kinh doanh Quản trị VinUni

Kiến thức về robots.txt, SEO kỹ thuật và quản trị website không chỉ phục vụ cho việc vận hành một trang web hiệu quả, mà còn là nền tảng quan trọng trong chiến lược kinh doanh kỹ thuật số hiện đại.

Kiến thức về SEO kỹ thuật, robots.txt hay quản trị website chỉ là một phần trong bức tranh tổng thể của chuyển đổi số doanh nghiệp. Để có thể phát triển bền vững trong môi trường digital marketing hiện đại, người làm marketing không chỉ cần kỹ năng chuyên môn mà còn phải hiểu cách vận hành, quản lý và tối ưu chiến lược dựa trên dữ liệu và công nghệ.

Khi muốn tiến xa hơn từ vị trí chuyên viên marketing lên cấp quản lý, trưởng nhóm hay giám đốc thương hiệu thì việc trang bị tư duy lãnh đạo và khả năng ra quyết định chiến lược là điều cần thiết. Một trong những hướng học phù hợp là theo đuổi chương trình Thạc sĩ Quản trị Kinh doanh (MBA) với trọng tâm về Đổi mới sáng tạo và Trí tuệ nhân tạo (Innovation & AI), được giảng dạy tại Viện Kinh doanh Quản trị VinUni.

Chương trình giúp học viên phát triển năng lực quản trị, tư duy đổi mới và khả năng tích hợp AI vào hoạt động kinh doanh – những yếu tố thiết yếu để điều hành đội nhóm marketing hiệu quả trong thời đại số. Đây là lựa chọn phù hợp cho những ai mong muốn mở rộng tầm nhìn, nâng cao kỹ năng ra quyết định và định hướng phát triển sự nghiệp ở cấp độ quản lý chiến lược.

Tìm hiểu thêm chi tiết về chương trình MBA tại VinUni tại: https://cbm.vinuni.edu.vn/vi/thac-si-quan-tri-kinh-doanh-ve-doi-moi-va-a-i/

![Chính sách phát triển năng lượng mặt trời mái nhà [Cập nhật 2026]](https://vinuni.edu.vn/wp-content/uploads/2026/02/chinh-sach-phat-trien-nang-luong-mat-troi-1.jpg)